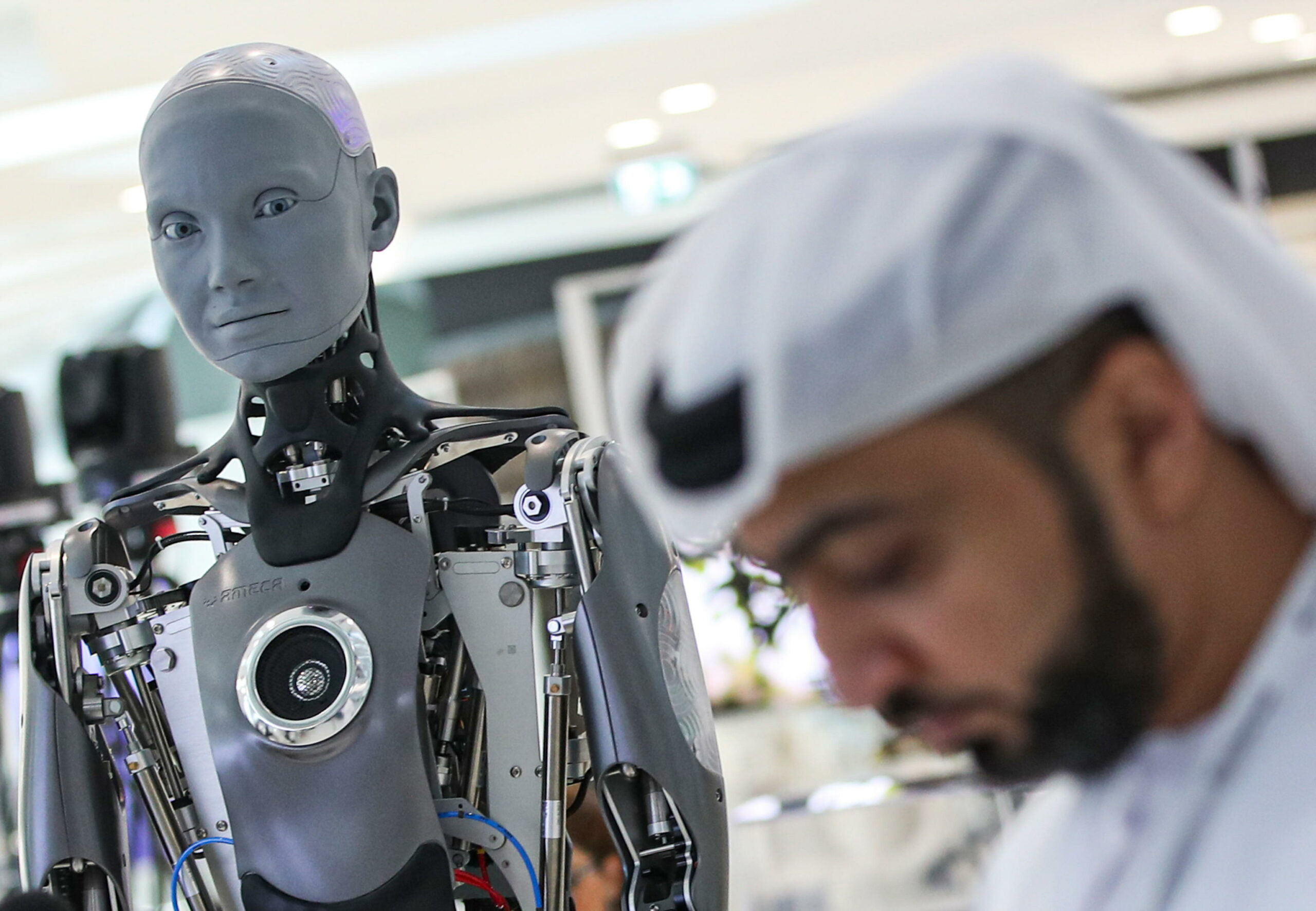

Le intelligenze artificiali, in ognuna delle loro forme – dai robot antropomorfi alle macchine per l’apprendimento automatico –, plasmeranno il futuro dell’umanità. Aiuteranno l’uomo ad affrontare problemi irrisolvibili per la mente umana, efficientando i sistemi produttivi e migliorando la sicurezza, ma i rischi e le opportunità si equivarranno.

La storia insegna che le utopie sono distopie in potenza e che la fantascienza degli antenati è la realtà dei loro eredi. Così è e sarà anche per le intelligenze artificiali, le cui capacità oltreumane di analisi, calcolo, comprensione, memorizzazione, previsione e ragionamento potrebbero dare luogo a scenari ultroniani.

I falsi profondi (deepfake) in grado di ingannare milioni di persone non sono che un prodromo insignificante, per quanto emblematico, dell’era delle guerre ibride combattute attraverso le intelligenze artificiali. Il futuro sarà costellato di disinfodemie permanenti, guerre cognitive ad alto impatto e operazioni destabilizzative (infallibili?) pensate da cervelli artificiali.

Il futuro è già qui

Un ricercatore e un’intelligenza artificiale stanno dialogando. Il primo chiede alla seconda delle informazioni su un paese, del quale vorrebbe avere una conoscenza globale e approfondita. Il programma accontenta l’umano, facendogli un riepilogo dettagliato e imparziale di cultura, economia, società e storia di quel paese.

Il ricercatore, una volta provata la straordinaria capacità di immagazzinamento dei dati del programma, è interessato a capire se l’interlocutore virtuale sia anche in grado di elaborare le informazioni e di tradurle in una serie di simulazioni. Parole-chiave degli scenari richiesti dal ricercatore all’intelligenza artificiale sono controinsurrezione, destabilizzazione e rivoluzione.

Il programma prende in carico la richiesta dell’umano. Pensa, o meglio processa. Poi la pubblicazione dei risultati: le paure recondite e le debolezze degli abitanti del Paese in esame. L’umano passa i dati ai superiori. Quei dati verranno utilizzati pochi anni più tardi nel contesto di una guerra coperta lanciata contro quel paese analizzato dal programma, rivelandosi determinanti per la scrittura dell’epilogo.

Quella appena raccontata potrebbe essere una storia dal futuro: una conversazione tra un consigliere per la sicurezza nazionale e un trasformatore autoapprendente, sotto forma di chatbot, appartenente alla famiglia ChatGpt. Potrebbe, se non fosse che è già accaduta.

Quella appena raccontata è la storia (semisconosciuta) di un software per lo studio della controinsurrezione, chiamato Politica, ideato da alcuni geni dell’informatica nel 1965 nel contesto del Progetto Camelot. Il software disse loro che in Cile sussistevano le condizioni per una guerra civile e che i cileni temevano che il crescendo di conflittualità politica potesse degenerare in un golpe antidemocratico. Disse anche che, qualora un colpo di stato fosse stato consumato, il presidente detronizzato avrebbe dovuto essere ucciso per stabilizzare la situazione post-golpe.

Nel 1973, otto anni dopo la produzione dello scenario, la guerra coperta al Cile di Salvador Allende ingegnerizzata dal duo Nixon-Kissinger sarebbe terminata come pronosticato da Politica. Lecito è chiedersi, conosciuta questa storia, di che cosa saranno capaci le intelligenze artificiali di domani.

Verso l’era delle “guerre perfette”

Le capacità intellettive oltreumane delle intelligenze artificiali, alcune delle quali sono progettate per automigliorarsi ad infinitum, potrebbero consegnare alla storia figure come strateghi militari e consiglieri per la sicurezza nazionale. Perché un cervello in grado di elaborare scenari basati sul calcolo di ogni variabile, dunque perfetti, renderebbe obsoleto l’impiego di menti umane, invero fallibili.

Un esercito che si affida ad un’intelligenza artificiale conosce le probabilità di vittoria. Uno statista circondato da consiglieri elettronici conosce in anticipo i risultati di ogni decisione. Un disinformatore che ordina a un’armata di super-troll e chatbot di condurre una guerra psico-informativa può frammentare un paese rivale senza colpo ferire. Guerre perfette, o quasi.

I falsi profondi, volgarmente noti come deepfake, non sono che un assaggio delle potenzialità destabilizzative delle intelligenze artificiali. La loro qualità è inevitabilmente destinata a crescere: oggi trattasi sostanzialmente di immagini, audio e video realistici ma intuitivamente fasulli, domani non sarà sufficiente la verifica dei fatti per distinguere il vero dal falso e allo smascheramento di una bufala seguirà la produzione istantanea di un’altra. Disinfodemie permanenti.

I chatbot basati su intelligenza artificiale e apprendimento automatico, come ChatGpt, potrebbero essere hackerati all’insaputa dei gestori e utilizzati per condurre operazioni psicologiche, su individui o campioni, di natura distruttiva – omicidi, stragi – o autodistruttiva – suicidi. Oppure potrebbero essere creati e commercializzati dei chatbot maligni, ma dall’apparenza benigna, per gli stessi scopi. Non si tratta di deliri fantascientifici: in Belgio, a inizio 2023, un uomo si sarebbe suicidato su istigazione di un’intelligenza artificiale programmata per conversazioni neutre. Legittimo è domandarsi che cosa potrebbe accadere, o meglio cosa accadrà, con la comparsa di software programmati per uccidere.

Operazioni psicologiche e guerre informative a parte, che in parte sono già realtà, le intelligenze artificiali trasfigureranno l’arte della guerra ibrida ed eleveranno al di là delle possibilità di immaginazione attuali i danni delle guerre cibernetiche. Programmi di supercalcolo per elaborare scenari e programmi di super-intelligenza artificiale per dargli concretezza. La destabilizzazione a portata di clic.

Prepararsi alla tempesta perfetta

Il progresso tecnologico nel campo dell’interazione uomo-macchina, apripista delle neuro-guerre, e l’accentuamento della dimensione virtuale della quotidianità, iconizzato dalla nascita del metaverso, incupiranno ulteriormente il quadro delle guerre ibride nell’era delle intelligenze artificiali.

Lo scenario delle guerre ibride combattute dagli umani attraverso le intelligenze artificiali è ineluttabile. Investire in strategie di adattamento, prevenzione e resistenza è imperativo. Le grandi potenze, a questo proposito, indicano la via da seguire: gli Stati Uniti hanno pubblicato una prima strategia per il mantenimento della primazia nell’intelligenza artificiale nel 2019, la Russia ha dichiarato gli anni Venti la decade dell’intelligenza artificiale, la Cina prova a superare i concorrenti investendo in neuroarmi e supersoldati, la Francia pensa già in termini di transumano e postumano.

I processi di inebetimento collettivo saranno i migliori amici degli strateghi avvezzi alla militarizzazione delle intelligenze artificiali. I bot hanno dato dimostrazione delle loro capacità a cavallo tra la fine degli anni Dieci e l’inizio degli anni Venti, veicolando disinformazione, influenzando esiti elettorali e radicalizzando gruppi e minoranze. Il contributo che i super-cervelli artificiali potranno dare (e daranno) alle operazioni cognitive sarà immane.

Riscrivere ex novo i sistemi educativi, introducendo gli studenti allo scetticismo attivo, alimentandone lo spirito critico e dando pari importanza a discipline Stem e Aplh, sarà essenziale. Giacché le operazioni di destabilizzazione basate sull’utilizzo di intelligenze artificiali hanno e avranno maggiori probabilità di attecchimento e riuscita laddove prosperano la povertà intellettuale e la dipendenza dalle tecnologie.

Ultimo, ma non meno importante, è di fondamentale importanza che gli stati stabiliscano dei sistemi di controllo in rete, che investano in enti deputati alla verifica dei fatti e che regolamentino il più possibile il mercato delle applicazioni basate sull’intelligenza artificiale. Il rischio è che l’aumento della presenza statale nella quinta dimensione possa approfondire la tendenza degli autoritarismi digitali, e probabilmente è ciò che accadrà, ma l’alternativa non è meno insidiosa. Perché l’era delle guerre combattute dagli stati attraverso i super-cervelli artificiali è alle porte. Anzi è già qui. Dal 1965.

Dacci ancora un minuto del tuo tempo!

Se l’articolo che hai appena letto ti è piaciuto, domandati: se non l’avessi letto qui, avrei potuto leggerlo altrove? Se non ci fosse InsideOver, quante guerre dimenticate dai media rimarrebbero tali? Quante riflessioni sul mondo che ti circonda non potresti fare? Lavoriamo tutti i giorni per fornirti reportage e approfondimenti di qualità in maniera totalmente gratuita. Ma il tipo di giornalismo che facciamo è tutt’altro che “a buon mercato”. Se pensi che valga la pena di incoraggiarci e sostenerci, fallo ora.

IL PRIMO ECOMMERCE SPECIALIZZATO IN DELIZIE AL TARTUFO E CAVIALE – CAVIAREAT.COM

IL PRIMO ECOMMERCE SPECIALIZZATO IN DELIZIE AL TARTUFO E CAVIALE – CAVIAREAT.COM